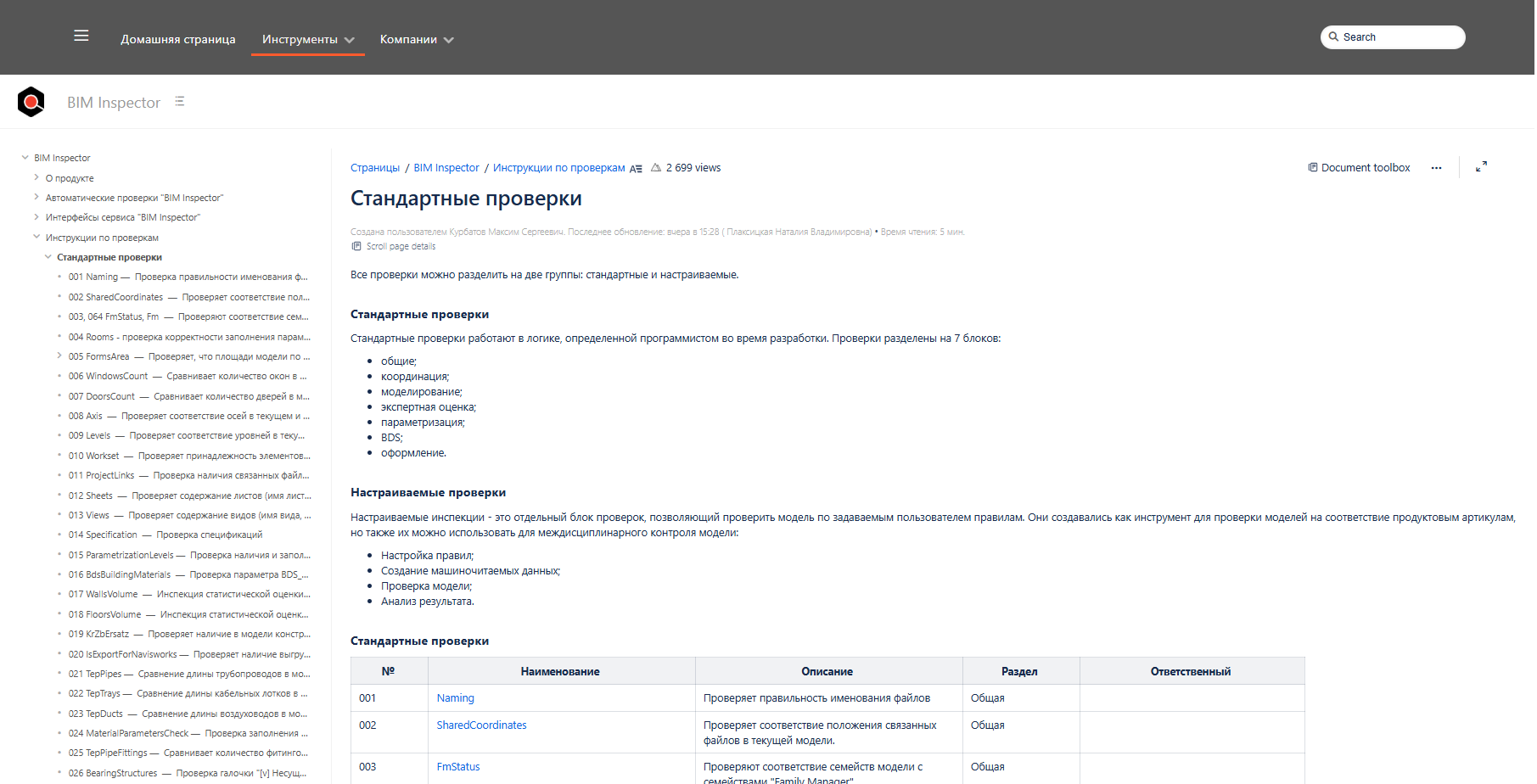

По мере развития продукта росла и база знаний: инструкции по проверкам, материалы по настройке, разбор исключений. Со временем пользоваться этой коллекцией стало трудно: документации много, поиск растягивается, соответственно и исправление ошибок в модели становится более трудозатратным.

Чтобы улучшить опыт работы с BIM Inspector мы решили создать сервис внутри Revit для быстрого доступа к базе знаний.

Решением стало внедрение ИИ-помощника в интерфейсе BIM Inspector внутри Revit.

Для проектировщика это выглядит как чат, в котором он может задать вопрос по работе продукта и там же получить на него ответ, сформированный ИИ на основе информации из базы знаний ПИК.

И вот, какие результаты мы получили в результате внедрения этой разработки:

● 2 000+ проектировщиков перестали тратить по 15–30 минут на поиск нужной инструкции среди 120+ страниц Confluence.

● Время нахождения ответа сократилось до пяти минут.

●Адаптация новых пользователей уменьшилась с 2–4 недель до 3–5 дней.

В этой статье мы хотим рассказать вам о технических подходах, примененных для разработки этой системы.

Решением стало внедрение ИИ-помощника в интерфейсе BIM Inspector внутри Revit.

Для проектировщика это выглядит как чат, в котором он может задать вопрос по работе продукта и там же получить на него ответ, сформированный ИИ на основе информации из базы знаний ПИК.

И вот, какие результаты мы получили в результате внедрения этой разработки:

● 2 000+ проектировщиков перестали тратить по 15–30 минут на поиск нужной инструкции среди 120+ страниц Confluence.

● Время нахождения ответа сократилось до пяти минут.

●Адаптация новых пользователей уменьшилась с 2–4 недель до 3–5 дней.

В этой статье мы хотим рассказать вам о технических подходах, примененных для разработки этой системы.

Подробности реализации

Вместо дообучения большой языковой модели — процесса, который требует значительных ресурсов и времени, — мы собрали ИИ-помощника на архитектуре RAG (Retrieval-Augmented Generation). Он не «знает всё», а подтягивает точные фрагменты из корпоративных источников и формирует из них ответ.

Как устроен наш RAG

Принцип работы можно разделить на 3 основных процесса:

Существуют различные подходы для их реализации, ниже описано то, что было выбрано нами.

Подготовка данных

● Источники: Confluence (120+ инструкций) и локальные файлы в форматах PDF, DOCX, XLSX, PPTX, Markdown, HTML.

● Чанкинг: документы режутся на части примерно по 300 символов с перекрытием 120 символов, чтобы логика предложения не терялась при разбиении.

● Векторизация: используем LaBSE — многоязычную модель эмбеддингов.

○ Вектор размером 768 измерений.

○ Поддержка 109 языков, в том числе русского и английского.

○ До 512 токенов на вход.

Семантическая близость работает независимо от языка: фразы «высота

Вместо дообучения большой языковой модели — процесса, который требует значительных ресурсов и времени, — мы собрали ИИ-помощника на архитектуре RAG (Retrieval-Augmented Generation). Он не «знает всё», а подтягивает точные фрагменты из корпоративных источников и формирует из них ответ.

Как устроен наш RAG

Принцип работы можно разделить на 3 основных процесса:

- Подготовка данных

- Поиск и отбор контента

- Генерация ответа

Существуют различные подходы для их реализации, ниже описано то, что было выбрано нами.

Подготовка данных

● Источники: Confluence (120+ инструкций) и локальные файлы в форматах PDF, DOCX, XLSX, PPTX, Markdown, HTML.

● Чанкинг: документы режутся на части примерно по 300 символов с перекрытием 120 символов, чтобы логика предложения не терялась при разбиении.

● Векторизация: используем LaBSE — многоязычную модель эмбеддингов.

○ Вектор размером 768 измерений.

○ Поддержка 109 языков, в том числе русского и английского.

○ До 512 токенов на вход.

Семантическая близость работает независимо от языка: фразы «высота

● Хранилища:

○ ChromaDB — векторный индекс для семантического поиска.

○NetworkX — граф связей между чанками (соседние фрагменты, разделы, примеры).

○ ChromaDB — векторный индекс для семантического поиска.

○NetworkX — граф связей между чанками (соседние фрагменты, разделы, примеры).

Поиск и отбор контента

- Расширение запроса: к исходной фразе автоматически добавляются синонимы и смежные термины, чтобы не упустить нужные формулировки из инструкций.

- Гибридный поиск: одновременно применяем

- лексический BM25+ (точные совпадения, сглаживание, учёт порядка слов и бонус за смежные термины);

- векторный поиск (семантика и синонимы, даже если слова не совпадают).

- Реранкинг: финальную выдачу оцениваем тремя независимыми сигналами:

1. cross-encoder для глубокой семантики,

2. метаданные (тип документа и дата обновления),

3. точные совпадения ключевых слов.

- Диверсификация: алгоритм MMR (λ=0.7) не даёт результатам «зациклиться» на одном и том же и обеспечивает покрытие разных аспектов вопроса.

- Контекстное расширение: по графу подтягиваем соседние куски — примеры, граничные условия, связанные правила. Это уменьшает риск вырванного из контекста совета.

Генерация ответа

Отобранные фрагменты передаются в LLM (используем DeepSeek Chat). На их основе формируется структурированный ответ:

● объяснение причины ошибки или поведения проверки;

● пошаговые действия по исправлению;

ссылки на первоисточники из базы знаний.

Отобранные фрагменты передаются в LLM (используем DeepSeek Chat). На их основе формируется структурированный ответ:

● объяснение причины ошибки или поведения проверки;

● пошаговые действия по исправлению;

ссылки на первоисточники из базы знаний.

При работе со сложными вопросами в стиле «как работает плагин, какие параметры заполнять и как настроить» система разбирает их на подзадачи.:

● принцип работы — концептуальный поиск,

● параметры — справочные фрагменты,

●настройка — процедурные шаги. Для каждой категории применяется своя стратегия поиска и реранкинга, а затем результаты собираются в единый, логично размеченный ответ. Это повышает полноту и снижает галлюцинации.

● принцип работы — концептуальный поиск,

● параметры — справочные фрагменты,

●настройка — процедурные шаги. Для каждой категории применяется своя стратегия поиска и реранкинга, а затем результаты собираются в единый, логично размеченный ответ. Это повышает полноту и снижает галлюцинации.

Что получили в итоге

В начале статьи мы написали про эффект, которого удалось достичь благодаря внедрению ИИ-помощника.

Почему это сработало:

● Мы не заменяли документацию — сделали её интерактивной.

● Мы не обучали модель с нуля — использовали уже накопленные знания.

●Мы добавили понимание контекста и кросс-языковую семантику. Главный принцип: не пользователь должен изучать систему, а система — понимать пользователя.

В начале статьи мы написали про эффект, которого удалось достичь благодаря внедрению ИИ-помощника.

Почему это сработало:

● Мы не заменяли документацию — сделали её интерактивной.

● Мы не обучали модель с нуля — использовали уже накопленные знания.

●Мы добавили понимание контекста и кросс-языковую семантику. Главный принцип: не пользователь должен изучать систему, а система — понимать пользователя.

Дальнейшие планы

Технологию, созданную для потребностей BIM Inspector, планируется вынести в отдельный сервис ИИ-помощника,который будет встроен в среду Revit.

Основная цель - реализовать “единое окно” для получения ответов на вопросы как работает тот или иной инструмент экосистемы ПИК. Благодаря такой реализации мы сможем обеспечить для пользователя более удобный процесс работы в ТИМ, когда, при возникновении трудностей не нужно отвлекаться от процесса проектирования. Добиться у проектировщика ощущения, что рядом с ним находится всегда готовый помочь BIM специалист.

Технологию, созданную для потребностей BIM Inspector, планируется вынести в отдельный сервис ИИ-помощника,который будет встроен в среду Revit.

Основная цель - реализовать “единое окно” для получения ответов на вопросы как работает тот или иной инструмент экосистемы ПИК. Благодаря такой реализации мы сможем обеспечить для пользователя более удобный процесс работы в ТИМ, когда, при возникновении трудностей не нужно отвлекаться от процесса проектирования. Добиться у проектировщика ощущения, что рядом с ним находится всегда готовый помочь BIM специалист.